1.快速单机安装:

在单机安装Hbase的方法。会引导你通过shell创建一个表,插入一行,然后删除它,最后停止Hbase。只要10分钟就可以完成以下的操作。

1.1下载解压最新版本

$ tar xfz hbase-0.90.4.tar.gz

$ cd hbase-0.90.4

现在你已经可以启动Hbase了。但是你可能需要先编辑conf/hbase-site.xml去配置hbase.rootdir,来选择Hbase将数据写到哪个目录 .

- <?xmlversion="1.0"?>

- <?xml-stylesheettype="text/xsl"href="configuration.xsl"?>

- <configuration>

- <property>

- <name>hbase.rootdir</name>

- <value>file:///DIRECTORY/hbase</value>

- </property>

- </configuration>

将DIRECTORY替换成你期望写文件的目录. 默认hbase.rootdir是指向/tmp/hbase-${user.name},也就说你会在重启后丢失数据(重启的时候操作系统会清理/tmp目录)

1.2.启动 HBase

现在启动Hbase:

$ ./bin/start-hbase.sh

starting Master, logging to logs/hbase-user-master-example.org.out

现在你运行的是单机模式的Hbaes。所以的服务都运行在一个JVM上,包括Hbase和Zookeeper。Hbase的日志放在logs目录,当你启动出问题的时候,可以检查这个日志。

1.3.Hbase Shell 练习

用shell连接你的Hbase

$ ./bin/hbase shell

HBase Shell; enter 'help<RETURN>' for list of supported commands.

Type "exit<RETURN>" to leave the HBase Shell

Version: 0.90.0, r1001068, Fri Sep 24 13:55:42 PDT 2010

hbase(main):001:0>

输入help然后<RETURN>可以看到一列shell命令。这里的帮助很详细,要注意的是表名,行和列需要加引号。

创建一个名为test的表,这个表只有一个column family 为cf。可以列出所有的表来检查创建情况,然后插入些值。

hbase(main):003:0> create 'test', 'cf'

0 row(s) in 1.2200 seconds

hbase(main):003:0> list 'table'

test

1 row(s) in 0.0550 seconds

hbase(main):004:0> put 'test', 'row1', 'cf:a', 'value1'

0 row(s) in 0.0560 seconds

hbase(main):005:0> put 'test', 'row2', 'cf:b', 'value2'

0 row(s) in 0.0370 seconds

hbase(main):006:0> put 'test', 'row3', 'cf:c', 'value3'

0 row(s) in 0.0450 seconds

以上我们分别插入了3行。第一个行key为row1, 列为cf:a, 值是value1。Hbase中的列是由 column family前缀和列的名字组成的,以冒号间隔。例如这一行的列名就是a.

检查插入情况.

Scan这个表,操作如下

hbase(main):007:0> scan 'test'

ROW COLUMN+CELL

row1 column=cf:a, timestamp=1288380727188, value=value1

row2 column=cf:b, timestamp=1288380738440, value=value2

row3 column=cf:c, timestamp=1288380747365, value=value3

3 row(s) in 0.0590 seconds

Get一行,操作如下

hbase(main):008:0> get 'test', 'row1'

COLUMN CELL

cf:a timestamp=1288380727188, value=value1

1 row(s) in 0.0400 seconds

disable 再 drop 这张表,可以清除你刚刚的操作

hbase(main):012:0> disable 'test'

0 row(s) in 1.0930 seconds

hbase(main):013:0> drop 'test'

0 row(s) in 0.0770 seconds

关闭shell

1.4.停止 HBase

运行停止脚本来停止HBase.

$ ./bin/stop-hbase.sh

stopping hbase...............

2 Hbase集群安装前注意

1)Java:(hadoop已经安装了)

2)Hadoop 0.20.x 已经正确安装,并且可以启动 HDFS 系统, 可参考的Hadoop安装文档:Hadoop集群配置(最全面总结)http://blog.csdn.net/hguisu/article/details/7237395

3)ssh 必须安装ssh,sshd也必须运行,这样Hadoop的脚本才可以远程操控其他的Hadoop和Hbase进程。ssh之间必须都打通,不用密码都可以登录,详细方法可以 Google一下 ("ssh passwordless login").

4)NTP:集群的时钟要保证基本的一致。稍有不一致是可以容忍的,但是很大的不一致会 造成奇怪的行为。 运行NTP或者其他什么东西来同步你的时间.

如果你查询的时候或者是遇到奇怪的故障,可以检查一下系统时间是否正确!

设置集群各个节点时钟:date -s“2012-02-13 14:00:00”

5)ulimit和nproc:

Base是数据库,会在同一时间使用很多的文件句柄。大多数linux系统使用的默认值1024是不能满足的,会导致FAQ: Why do I see "java.io.IOException...(Too manyopen files)" in my logs?异常。还可能会发生这样的异常

2010-04-06 03:04:37,542 INFO org.apache.hadoop.hdfs.DFSClient: ExceptionincreateBlockOutputStream java.io.EOFException

2010-04-06 03:04:37,542 INFO org.apache.hadoop.hdfs.DFSClient:Abandoning block blk_-6935524980745310745_1391901

所以你需要修改你的最大文件句柄限制。可以设置到10k. 你还需要修改 hbase 用户的 nproc,如果过低会造成 OutOfMemoryError异常。 [2] [3].

需要澄清的,这两个设置是针对操作系统的,不是Hbase本身的。有一个常见的错误是Hbase运行的用户,和设置最大值的用户不是一个用户。在Hbase启动的时候,第一行日志会现在ulimit信息,所以你最好检查一下。

设置ulimit:

如果你使用的是Ubuntu,你可以这样设置:

在文件/etc/security/limits.conf添加一行,如:

hadoop - nofile32768

可以把hadoop替换成你运行Hbase和Hadoop的用户。如果你用两个用户,你就需要配两个。还有配nproc hard 和 softlimits. 如:

hadoop soft/hard nproc 32000

在/etc/pam.d/common-session加上这一行:

session requiredpam_limits.so

否则在/etc/security/limits.conf上的配置不会生效.

还有注销再登录,这些配置才能生效!

7 )修改Hadoop HDFS Datanode同时处理文件的上限:dfs.datanode.max.xcievers

一个 Hadoop HDFS Datanode 有一个同时处理文件的上限. 这个参数叫xcievers(Hadoop的作者把这个单词拼错了). 在你加载之前,先确认下你有没有配置这个文件conf/hdfs-site.xml里面的xceivers参数,至少要有4096:

<property>

<name>dfs.datanode.max.xcievers</name>

<value>4096</value>

</property>

对于HDFS修改配置要记得重启.

如果没有这一项配置,你可能会遇到奇怪的失败。你会在Datanode的日志中看到xcievers exceeded,但是运行起来会报 missing blocks错误。例如:02/12/1220:10:31 INFO hdfs.DFSClient: Could not obtain blockblk_XXXXXXXXXXXXXXXXXXXXXX_YYYYYYYY from any node: java.io.IOException: No livenodes contain current block.

Will get new block locations from namenode andretry...

8)继承hadoop安装的说明:

每个机子/etc/hosts

10.64.56.74 node2 (master)

10.64.56.76 node1 (slave)

10.64.56.77 node3 (slave)

9) 继续使用hadoop用户安装

Chown –R hadoop /usr/local/hbase

3 分布式模式配置

3.1配置conf/hbase-env.sh

# exportJAVA_HOME=/usr/java/jdk1.6.0/

exportJAVA_HOME=/usr/lib/jvm/java-6-sun-1.6.0.26

# Tell HBase whether it should manage it'sown instance of Zookeeper or not.

export HBASE_MANAGES_ZK=true

不管是什么模式,你都需要编辑conf/hbase-env.sh来告知Hbasejava的安装路径.在这个文件里你还可以设置Hbase的运行环境,诸如 heapsize和其他JVM有关的选项, 还有Log文件地址,等等. 设置JAVA_HOME指向java安装的路径.

一个分布式运行的Hbase依赖一个zookeeper集群。所有的节点和客户端都必须能够访问zookeeper。默认的情况下Hbase会管理一个zookeep集群。这个集群会随着Hbase的启动而启动。当然,你也可以自己管理一个zookeeper集群,但需要配置Hbase。你需要修改conf/hbase-env.sh里面的HBASE_MANAGES_ZK来切换。这个值默认是true的,作用是让Hbase启动的时候同时也启动zookeeper.

让Hbase使用一个现有的不被Hbase托管的Zookeep集群,需要设置conf/hbase-env.sh文件中的HBASE_MANAGES_ZK属性为 false

# Tell HBase whether it should manage it's own instanceof Zookeeper or not.

exportHBASE_MANAGES_ZK=false

3.2 配置conf/hbase-site.xml

- <configuration>

- <property>

- <name>hbase.rootdir</name>

- <value>hdfs://node1:49002/hbase</value>

- <description>ThedirectorysharedbyRegionServers.

- </description>

- </property>

- <property>

- <name>hbase.cluster.distributed</name>

- <value>true</value>

- <description>Themodetheclusterwillbein.Possiblevaluesare

- false:standaloneandpseudo-distributedsetupswithmanagedZookeeper

- true:fully-distributedwithunmanagedZookeeperQuorum(seehbase-env.sh)

- </description>

- </property>

- <property>

- <name>hbase.zookeeper.property.clientPort</name>

- <value>2222</value>

- <description>PropertyfromZooKeeper'sconfigzoo.cfg.

- Theportatwhichtheclientswillconnect.

- </description>

- </property>

- <property>

- <name>hbase.zookeeper.quorum</name>

- <value>node1,node2,node3</value>

- <description>CommaseparatedlistofserversintheZooKeeperQuorum.

- Forexample,"host1.mydomain.com,host2.mydomain.com,host3.mydomain.com".

- Bydefaultthisissettolocalhostforlocalandpseudo-distributedmodes

- ofoperation.Forafully-distributedsetup,thisshouldbesettoafull

- listofZooKeeperquorumservers.IfHBASE_MANAGES_ZKissetinhbase-env.sh

- thisisthelistofserverswhichwewillstart/stopZooKeeperon.

- </description>

- </property>

- <property>

- <name>hbase.zookeeper.property.dataDir</name>

- <value>/home/hadoop/zookeeper</value>

- <description>PropertyfromZooKeeper'sconfigzoo.cfg.

- Thedirectorywherethesnapshotisstored.

- </description>

- </property>

- </configuration>

要想运行完全分布式模式,加一个属性hbase.cluster.distributed设置为true然后把hbase.rootdir设置为HDFS的NameNode的位置。 例如,你的namenode运行在node1,端口是49002 你期望的目录是/hbase,使用如下的配置:hdfs://node1:49002/hbase

hbase.rootdir:这个目录是region server的共享目录,用来持久化Hbase。URL需要是'完全正确'的,还要包含文件系统的scheme。例如,要表示hdfs中的'/hbase'目录,namenode 运行在node1的9090端口。则需要设置为hdfs://node1:49002/hbase。默认情况下Hbase是写到/tmp的。不改这个配置,数据会在重启的时候丢失。默认:file:///tmp/hbase-${user.name}/hbase

hbase.cluster.distributed :Hbase的运行模式。false是单机模式,true是分布式模式。若为false,Hbase和Zookeeper会运行在同一个JVM里面。

默认:false

在hbase-site.xml配置zookeeper:

当Hbase管理zookeeper的时候,你可以通过修改zoo.cfg来配置zookeeper,

一个更加简单的方法是在conf/hbase-site.xml里面修改zookeeper的配置。Zookeeer的配置是作为property写在hbase-site.xml里面的。

对于zookeepr的配置,你至少要在hbase-site.xml中列出zookeepr的ensemble servers,具体的字段是hbase.zookeeper.quorum. 该这个字段的默认值是localhost,这个值对于分布式应用显然是不可以的. (远程连接无法使用)。

hbase.zookeeper.property.clientPort:ZooKeeper的zoo.conf中的配置。 客户端连接的端口。

hbase.zookeeper.quorum:Zookeeper集群的地址列表,用逗号分割。例如:"host1.mydomain.com,host2.mydomain.com,host3.mydomain.com".默认是localhost,是给伪分布式用的。要修改才能在完全分布式的情况下使用。如果在hbase-env.sh设置了HBASE_MANAGES_ZK,这些ZooKeeper节点就会和Hbase一起启动。

默认:localhost

运行一个zookeeper也是可以的,但是在生产环境中,你最好部署3,5,7个节点。部署的越多,可靠性就越高,当然只能部署奇数个,偶数个是不可以的。你需要给每个zookeeper 1G左右的内存,如果可能的话,最好有独立的磁盘。 (独立磁盘可以确保zookeeper是高性能的。).如果你的集群负载很重,不要把Zookeeper和RegionServer运行在同一台机器上面。就像DataNodes 和 TaskTrackers一样

hbase.zookeeper.property.dataDir:ZooKeeper的zoo.conf中的配置。 快照的存储位置

把ZooKeeper保存数据的目录地址改掉。默认值是/tmp,这里在重启的时候会被操作系统删掉,可以把它修改到/home/hadoop/zookeeper (这个路径hadoop用户拥有操作权限)

对于独立的Zookeeper,要指明Zookeeper的host和端口。可以在hbase-site.xml中设置, 也可以在Hbase的CLASSPATH下面加一个zoo.cfg配置文件。 HBase 会优先加载zoo.cfg里面的配置,把hbase-site.xml里面的覆盖掉.

参见http://www.yankay.com/wp-content/hbase/book.html#hbase_default_configurations可以查找hbase.zookeeper.property前缀,找到关于zookeeper的配置。

3.3 配置conf/regionservers

Node1

Node2

完全分布式模式的还需要修改conf/regionservers.在这里列出了你希望运行的全部HRegionServer,一行写一个host (就像Hadoop里面的slaves一样). 列在这里的server会随着集群的启动而启动,集群的停止而停止.

4 运行和确认你的安装

4.1当Hbase托管ZooKeeper的时候

当Hbase托管ZooKeeper的时候Zookeeper集群的启动是Hbase启动脚本的一部分

首先确认你的HDFS是运行着的。你可以运行HADOOP_HOME中的bin/start-hdfs.sh来启动HDFS.你可以通过put命令来测试放一个文件,然后有get命令来读这个文件。通常情况下Hbase是不会运行mapreduce的。所以比不需要检查这些。

用如下命令启动Hbase:

bin/start-hbase.sh

这个脚本在HBASE_HOME目录里面。

你现在已经启动Hbase了。Hbase把log记在logs子目录里面. 当Hbase启动出问题的时候,可以看看Log.

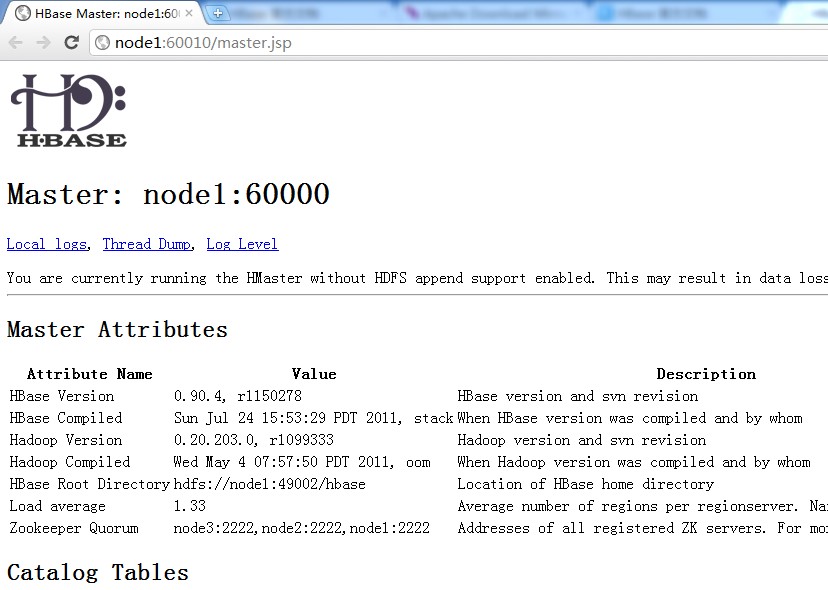

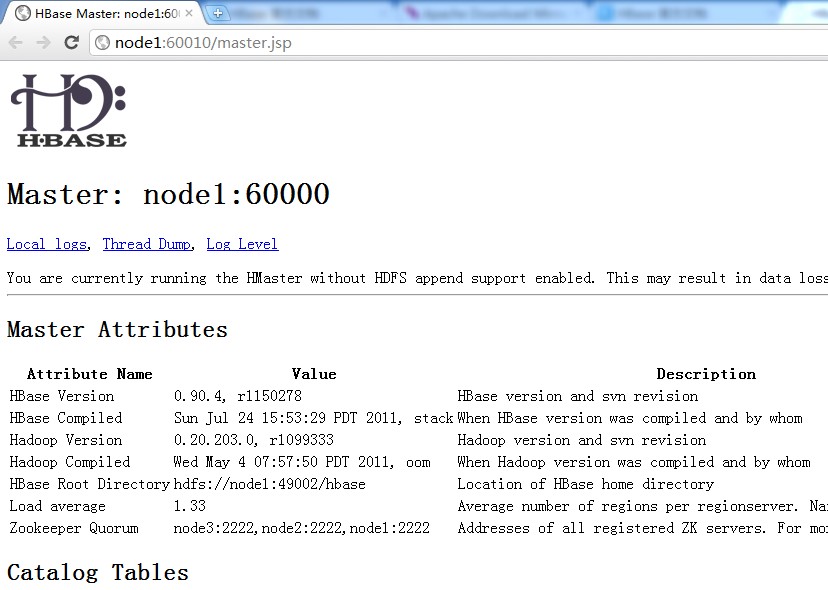

Hbase也有一个界面,上面会列出重要的属性。默认是在Master的60010端口上H (HBase RegionServers 会默认绑定 60020端口,在端口60030上有一个展示信息的界面 ).如果Master运行在node1,端口是默认的话,你可以用浏览器在http://node:60010看到主界面. .

一旦Hbase启动,可以看到如何建表,插入数据,scan你的表,还有disable这个表,最后把它删掉。

可以在Hbase Shell停止Hbase

$./bin/stop-hbase.sh

stoppinghbase...............

停止操作需要一些时间,你的集群越大,停的时间可能会越长。如果你正在运行一个分布式的操作,要确认在Hbase彻底停止之前,Hadoop不能停.

4.2独立的zookeeper启动,

除了启动habse,

执行:bin/start-hbase.sh启动habse

你需要自己去运行zookeeper:

${HBASE_HOME}/bin/hbase-daemons.sh {start,stop} zookeeper

你可以用这条命令启动ZooKeeper而不启动Hbase.HBASE_MANAGES_ZK的值是false, 如果你想在Hbase重启的时候不重启ZooKeeper,你可以这样。

5.测试:

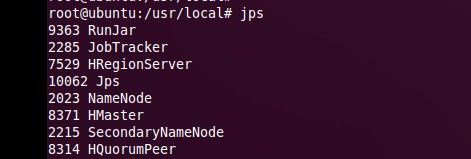

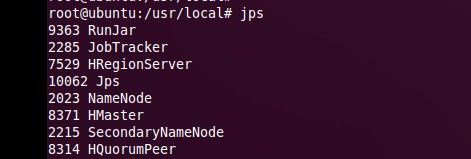

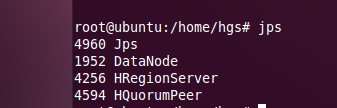

可以使用jps查看进程:在master上:

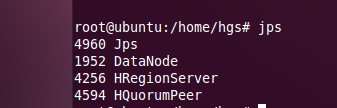

在node2,node3(slave节点)上

通过浏览器查看60010端口:

6 在安装中出现的问题:

1 )

用./start-hbase.sh启动HBase后,执行hbase shell

# bin/hbase shell

HBase Shell; enter 'help<RETURN>' for list of supported commands.

Version: 0.20.6, rUnknown, Thu Oct 28 19:02:04 CST 2010

接着创建表时候出现如下情况:hbase(main):001:0> create 'test',''c

NativeException: org.apache.hadoop.hbase.MasterNotRunningException: null

jps下,发现主节点上HMaster没有启动,查理HBase log(logs/hbase-hadoop-master-ubuntu.log)里有下面异常:

FATAL org.apache.hadoop.hbase.master.HMaster: Unhandled exception. Starting shutdown.

java.io.IOException: Call to node1/10.64.56.76:49002 failed on local exception: java.io.EOFException

解决:

从hadoop_home/下面cp一个hadoop/hadoop-core-0.20.203.0.jar到hbase_home/lib下。

因为Hbase建立在Hadoop之上,所以他用到了hadoop.jar,这个Jar在 lib 里面。这个jar是hbase自己打了branch-0.20-append 补丁的hadoop.jar. Hadoop使用的hadoop.jar和Hbase使用的 必须 一致。所以你需要将 Hbaselib 目录下的hadoop.jar替换成Hadoop里面的那个,防止版本冲突。比方说CDH的版本没有HDFS-724而branch-0.20-append里面有,这个HDFS-724补丁修改了RPC协议。如果不替换,就会有版本冲突,继而造成严重的出错,Hadoop会看起来挂了。

再用./start-hbase.sh启动HBase后,jps下,发现主节点上HMaster还是没有启动,在HBase log里有下面异常:

FATAL org.apache.hadoop.hbase.master.HMaster: Unhandled exception. Starting shutdown.

java.lang.NoClassDefFoundError: org/apache/commons/configuration/Configuration

解决:

在NoClassDefFoundError,缺少 org/apache/commons/configuration/Configuration

果断给他加一个commons-configuration包,

从hadoop_home/lib下面cp一个hadoop/lib/commons-configuration-1.6.jar到hbase_home/lib下。

(集群上所有机子的hbase配置都需要一样)

2 注意事项:

1)、先启动hadoop后,再开启hbase

2)、去掉hadoop的安全模式:hadoop dfsadmin -safemode leave

3)、把/etc/hosts里的ubuntu的IP改为服务器当前的IP

4) 、确认hbase的hbase-site.xml中

<name>hbase.rootdir</name>

<value>hdfs://node:49002/hbase</value>

与hadoop的core-site.xml中

<name>fs.default.name</name>

<value>hdfs://node:49002/hbase</value>

红字部分保持一致

<value>hdfs://localhost:8020/hbase</value>

6)、重新执行./start-hbase.sh之前,先kill掉当前的hbase和zookeeper进程

PS:遇到问题时,先查看logs,很有帮助。

HBase 官方文档,全面介绍hbase安装配置:

http://www.yankay.com/wp-content/hbase/book.html#hbase_default_configurations

分享到:

相关推荐

搭建hadoop单机版+hbase单机版+pinpoint整合springboot

Hadoop Hive与Hbase整合配置

hadoop和hbase分布式配置及整合eclipse开发,帮助大家配置hadoop和hbase,希望对大家有帮助!

jdk1.8.0_131、apache-zookeeper-3.8.0、hadoop-3.3.2、hbase-2.4.12 mysql5.7.38、mysql jdbc驱动mysql-connector-java-8.0.8-dmr-bin.jar、 apache-hive-3.1.3 2.本文软件均安装在自建的目录/export/server/下 ...

hadoop和hbase分布式配置及整合eclipse开发.pdf

一、Kettle整合Hadoop 1、 整合步骤 2、Hadoop file input组件 3、Hadoop file output组件 二、Kettle整合Hive 1、初始化数据 2、 kettle与Hive 整合配置 3、从hive 中读取数据 4、把数据保存到hive数据库 5、...

hadoop jar /usr/lib/hbase/hbase-0.90.4-cdh3u3.jar importtsv -Dimporttsv.columns=HBASE_ROW_KEY, catgyname,catgyid1,catgyname1,catgyid2,catgyname2,catgyid3,catgyname3,catgyid4,catgyname4,catgyid5,...

第一天 hadoop的基本概念 伪分布式hadoop集群安装 hdfs mapreduce 演示 01-hadoop职位需求状况.avi 02-hadoop课程安排.avi 03-hadoop应用场景.avi 04-hadoop对海量数据处理的解决思路.avi 05-hadoop版本选择和...

第2章详细讲解了hadoop集群的安装和配置,以及常用的日志分析技巧;第3章分析了hadoop在yahoo!、ebay、facebook和百度的应用案例,以及hadoop平台上海量数据的排序;第4-7章深入地讲解了mapreduce计算模型、...

linux下hadoop搭建与eclipse开发环境配置,包括hadoop中的 master、slaves工作过程处理

第2章详细讲解了hadoop集群的安装和配置,以及常用的日志分析技巧;第3章分析了hadoop在yahoo!、ebay、facebook和百度的应用案例,以及hadoop平台上海量数据的排序;第4-7章深入地讲解了mapreduce计算模型、...

第2章详细讲解了hadoop集群的安装和配置,以及常用的日志分析技巧;第3章分析了hadoop在yahoo!、ebay、facebook和百度的应用案例,以及hadoop平台上海量数据的排序;第4-7章深入地讲解了mapreduce计算模型、...

hadoop安装的整理:hadoop高可用性集群配置,整合了包含hadoop,hbase等集群的安装的配置文件的设置

如何整合MapReduce和R前言 致谢关于本书 第1 部分 背景和基本原理1 跳跃中的Hadoop1.1 什么是Hadoop 1.1.1 Hadoop 的核心组件1.1.2 Hadoop 生态圈1.1.3 物理架构1.1.4 谁在使用Hadoop1.1.5 ...

第2章详细讲解了hadoop集群的安装和配置,以及常用的日志分析技巧;第3章分析了hadoop在yahoo!、ebay、facebook和百度的应用案例,以及hadoop平台上海量数据的排序;第4-7章深入地讲解了mapreduce计算模型、...

第2章详细讲解了Hadoop集群的安装和配置,以及常用的日志分析技巧;第3章分析了Hadoop在Yahoo!、eBay、Facebook和百度的应用案例,以及Hadoop平台上海量数据的排序;第4-7章深入地讲解了MapReduce计算模型、...

本人写的大数据平台搭建教程,包含基于hive的离线分析、基于storm的实时分析、包含solrcloud和hbase的搜索架构等基础组件的配置及整合

0. 重新编译依赖包编译过程参考:- Hive整合Hbase详解删除软链接的命令修改hive-site.xml的配置主要修改zookeeper的配置项,以便能够

Hadoop高可用配置 HadoopCommon分析 HDFS集群相关管理 HDFS Shell 5.2 MapReduce 分布式处理框架MapReduce MapReduce概览 MapReduce调优 MapReduce数据相关操作 MapReduce输入输出剖析 MapReduce的工作机制 5.3 Yarn...